A inteligência artificial é neutra? Este documentário da Netflix mostra que um algoritmo é tão imparcial quanto as pessoas – e os dados – que o criaram.

Ficha Resumida

– Título Original: Coded Bias

– Duração: 90 minutos (Filme único)

– Ano: 2020

– País: Estados Unidos

– Direção: Shalini Kantayya

– Distribuição: Netflix

O Documentário como estímulo ao debate

Se Privacidade Hackeada mostrou como seus dados podem ser usados para manipular sua vontade, Viés Codificado (Coded Bias) vai um passo além: mostra como esses mesmos sistemas podem distorcer a realidade de quem você é.

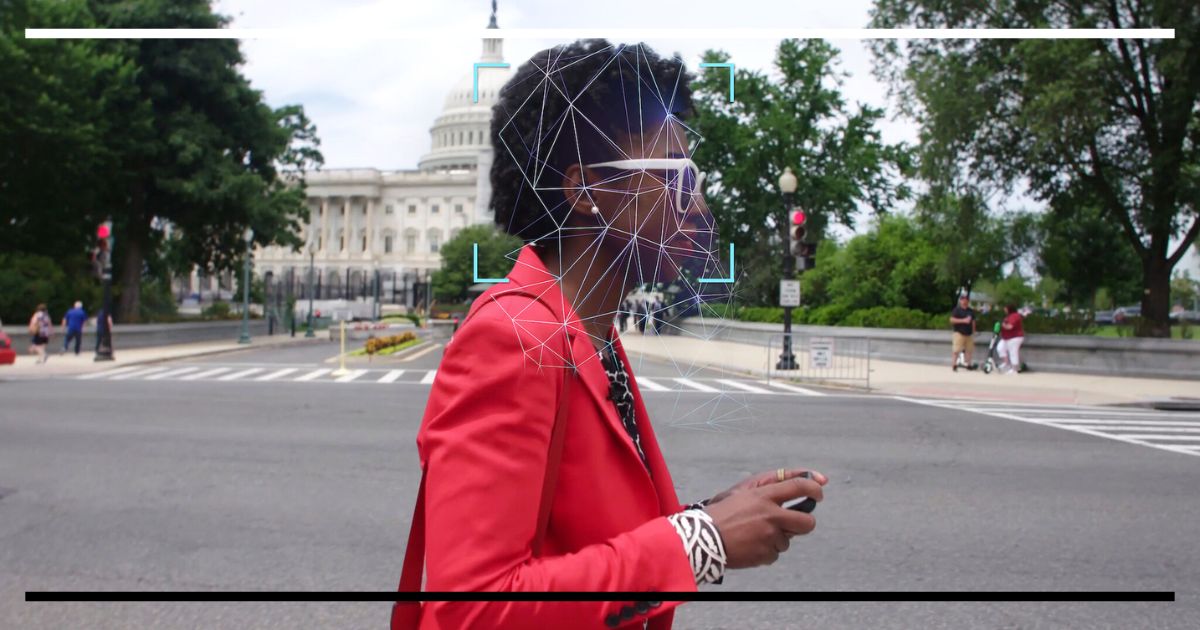

O ponto de partida é a descoberta da pesquisadora do MIT Joy Buolamwini – que precisou colocar uma máscara branca para ser reconhecida pelo algoritmo que ela mesma programava. O sistema simplesmente não enxergava o seu rosto.

O que parece um bug técnico é, na verdade, um sintoma de algo mais profundo. Como Buolamwini afirmou em depoimento ao Congresso americano:

“Conduzi estudos que mostram alguns dos maiores vieses raciais já registrados em sistemas de IA vendidos por empresas como IBM, Microsoft e Amazon.”

A tecnologia não é neutra. Ela carrega os preconceitos de quem a construiu.

Onde o viés nasce: dados e representação

O problema não é um erro de cálculo – é um viés de representação.

Para entender por que, é preciso entender como uma IA “aprende”.

Como o algoritmo aprende (e como aprende errado)

Um sistema de reconhecimento facial é treinado com milhares de imagens.

Se a base de dados usada nesse treinamento for composta majoritariamente por rostos de homens brancos – como era o caso dos sistemas analisados por Buolamwini –, o algoritmo simplesmente não desenvolve a capacidade de reconhecer com precisão rostos femininos ou de pele escura.

O computador não discrimina por maldade. Ele discrimina porque foi ensinado com dados incompletos. E depois vai ao mundo tomar decisões como se fosse imparcial.

A “Caixa Preta” e o segredo industrial

O segundo problema é ainda mais difícil de resolver: a falta de transparência.

Muitos sistemas de IA operam como caixas-pretas – nem os próprios criadores conseguem explicar, passo a passo, como o algoritmo chegou a determinada decisão.

E quando questionados, as empresas se protegem sob o argumento do segredo industrial. O resultado é um sistema que toma decisões que afetam vidas sem que ninguém precise se responsabilizar por elas.

Para uma leitura mais aprofundada sobre transparência algorítmica, o relatório da AI Now Institute é uma referência internacional no tema.

Quando o algoritmo vira juiz

Quando esses sistemas saem do laboratório e entram no cotidiano, o viés deixa de ser um problema técnico e vira injustiça social.

O documentário acompanha casos reais em duas áreas especialmente sensíveis:

- Segurança pública: prisões indevidas motivadas por falhas no reconhecimento facial – em que o algoritmo identificou erroneamente suspeitos negros como autores de crimes

- Acesso a crédito e moradia: algoritmos usados por bancos e plataformas que negavam oportunidades com base em padrões históricos de discriminação, perpetuando desigualdades em vez de corrigi-las

- Contratação e educação: sistemas automatizados de triagem de currículos e de avaliação estudantil que penalizavam candidatos por características associadas a grupos historicamente marginalizados

Em todos os casos, a vítima sequer sabia que havia sido julgada por um algoritmo – muito menos como contestar essa decisão.

A Lição

A lição de Viés Codificado é que a ciência da computação não existe num vácuo ético. Um algoritmo não é um árbitro imparcial – é um espelho dos dados e das escolhas de quem o criou.

Não podemos aceitar passivamente a “autoridade” da máquina. Toda decisão automatizada que afeta uma vida – emprego, crédito, liberdade – precisa ser questionável, auditável e contestável.

Exigir isso não é ser contra a tecnologia. É ser a favor das pessoas.

Continue o Debate

Este texto faz parte da série Manipulação, Viés e Vício: 3 Documentários da Netflix para entender a Era Digital.

O próximo – e último – texto da série analisa O Dilema das Redes (The Social Dilemma): o modelo de negócios que transformou sua atenção em produto.

Se este conteúdo foi útil, compartilhe com quem ainda acredita que a tecnologia é sempre neutra.